Produzieren mit einer externen Anwendung (Teams Encoder Event)

Externe Anwendungen für die Produktion (Encoder)

Definition

Komprimiert Audio und Video aus verschiedenen Eingaben und sendet diese Ausgabe an einen Streaming-Dienst.

Einstellungen

RTMP(s) – einzelne Bitrate

Video:

- Codec: H.264, Hoch

- Fragmentgröße: 2 Sek

- Bitrate: bis zu 5 Mbit/s, CBR, 30 fps

- Auflösung: Max. 720p

Audio:

- Codec: AAC-LC

- Bitrate: 192 kbps

- Abtastrate: 48 kHz

Hinweis: Es müssen sowohl Audio als auch Video vorhanden sein.

Beliebte Encoder

Einführung in den erweiterten Produktionsworkflow mit einer externen Anwendung

Zeitlicher Ablauf

Veranstalter

Veranstalter

Mit App/Gerät produzieren

Hersteller

RTMP-Gerät

Live gehen

Hersteller

Hersteller

Cloud-Bereitstellung

Azure Mediendienste

Content-Delivery-Netzwerk

Netzwerkoptimierung

(eCDN-Lösungen)

Aussicht

Publikum

Auf dem Desktop ansehen,

Internet, mobil

Beitritt als Produzent – aus Teams oder Outlook

Nimm am Live-Event teil als Hersteller oder Moderator aus Ihrem Teams-Kalender oder aus Ihrem Outlook-Kalender.

Anschließen Ihres Encoders (OBS-Beispiel)

Geben Sie in Ihrer Codierungssoftware die RTMP-Aufnahme-URL(s) an, um die Ausgabe des Encoders mit dem Live-Event zu verbinden.

Gehen Sie in OBS Studio zum Steuerungsdock und klicken Sie auf Einstellungen.

- In dem Service Dropdown, auswählen Brauch…

- In dem Server Textfeld, fügen Sie den Wert aus ein RTMP – In-Server-Ingest-URL.

- In dem Stream-Schlüssel Geben Sie im Feld den Wert ein RTMP – Im Stream-Schlüssel oder -Namen.

- Klicken OK (oder Anwenden).

Stellen Sie Ihren Encoder-Inhalt in die Warteschlange

Live senden und starten

Produzieren mit einer externen Anwendung (Stream Encoder Event)

Überlegungen zur Nutzung von Teams in virtuellen Events:

| Produkt | Teams treffen Teams-Webinar |

Microsoft 365 Live-Event, produziert über Teams | Live-Events Teams-Encoder oder Stream-Encoder |

| Lieferplattform | |||

| Publikum |

Intern Extern |

Intern Extern |

Intern (Azure AD-Gäste werden nur mit Teams Encoder unterstützt) Extern (nur Teams Encoder) |

| Zugang |

Authentifiziert oder anonym (Besprechungen) Anmeldung (Webinare) |

Intern: Organisationsweit oder Personen und Gruppen (Azure AD-Konto erforderlich [Mitglied/Gast]) Extern: Öffentlich (keine Anmeldung erforderlich) |

Intern: Organisationsweit oder Personen und Gruppen (Azure AD-Konto erforderlich [Mitglied/Gast]) Extern: Öffentlich (keine Anmeldung erforderlich) – nur Teams Encoder |

| Publikumsgröße | 1.000 interaktiv, 20.000 nur mit Ansicht (Meetings) 1000-Limit (derzeit für Webinare) |

10.000 (20.000 bis 31. Dezember 2023) | 10.000 (20.000 bis 31. Dezember 2023) |

| Selbst ausführen (keine Produktionsbeteiligung) | Ja | Ja | Nein |

| Hardware-Anforderungen | PC/Kamera | PC/Kamera | Produktion (Kamera-Audio, Live-Umschaltung) + Encoder (Hardware oder Software) |

| Dauer | 30 Stunden | 16 Stunden (bis 31. Dezember 2023) | 16 Stunden (bis 31. Dezember 2023) |

|

Live-Mischung von Quellen/Moderatoren im Meeting Eindeutige Rollen stärken Produzenten, Moderatoren und Teilnehmer |

Nein | Ja | Nein |

| Bildunterschriften | Live-Untertitel (integriert mit KI-Technologie) CART-Untertitel (vom Menschen erstellt) |

KI-Untertitel (Teams) | 608/708 Untertitel (nur Teams Encoder) |

| Untertitel-Übersetzungen | Ja (mit KI-Technologie) | Bis zu 6 Sprachen (mit KI-Technologie) | Nein |

| Moderierte Fragen und Antworten (Chat) | Verfügbar | Verfügbar | Verfügbar |

| Nicht moderierte Fragen und Antworten (Chat) | Ja | Nein | Nein |

| Verbale Fragen und Antworten innerhalb der Plattform | Ja | Nur Moderatoren | Nur Moderatoren |

| Automatischer Übergang von Live zu VOD |

Nein |

Ja | Ja |

| Berichterstattung | Teilnehmerberichterstattung |

Einzigartige Zuschauerzahl GEO Betrachtungsdauer Individuelle Pseudonyme |

Einzigartige Zuschauerzahl GEO Betrachtungsdauer Individuelle Aliase (nur Teams Encoder) |

Publikum

Produktion

Bildunterschriften

Interaktivität

Nach der Veranstaltung

Beitritt als Produzent – aus Teams oder Outlook

Nimm am Live-Event teil als Hersteller oder Moderator aus Ihrem Teams-Kalender oder aus Ihrem Outlook-Kalender.

Beitritt als Moderator (moderierte Frage-und-Antwort-Runde)

Wenn ein in Teams geplantes Live-Event mit einer externen App oder einem Encoder produziert wird, stehen den Moderatoren dieses Events keinerlei Audio-/Videofunktionen zur Verfügung. Sie können das Frage-und-Antwort-Panel moderieren (falls aktiviert), mit dem/den Produzenten chatten und den Livestream im Client ansehen.

Die Moderatoren haben hier Zugriff auf die moderierten Fragen und Antworten.

Anschließen Ihres Encoders (OBS-Beispiel)

Geben Sie in Ihrer Codierungssoftware die RTMP-Aufnahme-URL(s) an, um die Ausgabe des Encoders mit dem Live-Event zu verbinden.

Gehen Sie in OBS Studio zum Steuerungsdock und klicken Sie auf Einstellungen.

- In dem Service Dropdown, auswählen Brauch…

- In dem Server Textfeld, fügen Sie den Wert aus ein RTMP – In-Server-Ingest-URL.

- In dem Stream-Schlüssel Geben Sie im Feld einen beliebigen Wert ein (z. B 12345).

Notiz: Teams-Live-Events mit Stream nutzen keinen Stream-Schlüssel; Die OBS Studio-Software erfordert jedoch, dass in dieses Feld ein Wert eingegeben wird.

Die Aufnahme-URL des sekundären Servers (auch Aufnahme-URL des redundanten Servers genannt) ist nicht als Backup gedacht. Der Encoder überträgt Inhalte mit demselben Zeitstempel und denselben Daten sowohl an die primäre als auch an die redundante Aufnahme-URL, was die Haltbarkeit und Ausfallsicherheit des Inhalts verbessert.

Anschließen Ihres Encoders

Beachten Sie, wann Starten Sie das Streaming Wenn Sie hier klicken, wird damit begonnen, die Ausgabe von der App/dem Encoder an das Live-Event zu senden. Dadurch wird die Veranstaltung NICHT live für die Teilnehmer geschaltet. Dies muss innerhalb der Teams Producer-Erfahrung erfolgen.

Stellen Sie sicher, dass der Streaming-Prozess funktioniert. Der Produzent sieht im Teams-Client eine Vorschau (ca. 30 Sekunden verzögert).

Wenn bereit, drücke den Veranstaltung starten Taste, um GEH LEBEN!

ERINNERUNG: Sobald die Veranstaltung gestartet ist, kann sie nur gestoppt (nicht pausiert oder neu gestartet) werden.

Extrahieren von Quellen aus Teams

Extrahieren von Inhalten aus einer Teams-Besprechung (Quelle)

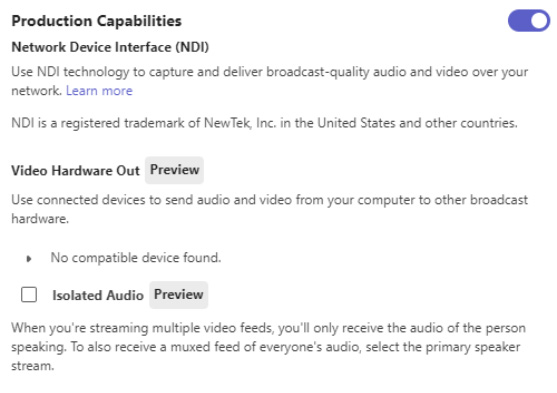

Verwendung von NDI

Remote-Teilnehmer

Teams treffen

Quelle

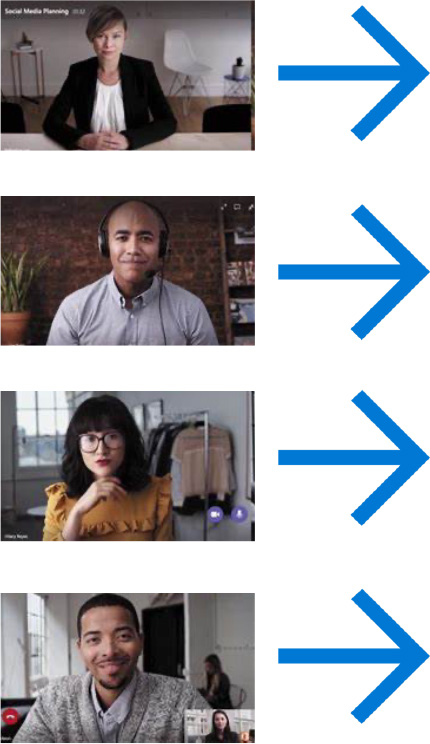

Dieses System nimmt an der Teams-Besprechung teil und verwendet NDI, um die isolierten Video-Feeds und gemischten Audio-Feeds zu extrahieren.

Aktivieren Sie NDI im Teams-Client (Einstellungen -> App-Berechtigungen).

Stellen Sie sicher, dass Video-Feeds vorhanden sind aktiv im Teams-Client.

- Wählen Sie Videos wie gewünscht aus und pinnen Sie sie an (maximal 9 Video-Feeds; dies hängt jedoch von der Hardware und dem Netzwerk ab und wird im Allgemeinen 2–3 pro Maschine nicht überschreiten).

- Aufrufen der großen Galerie (optional, falls gewünscht)

- Aufrufen des Together-Modus (optional, falls gewünscht)

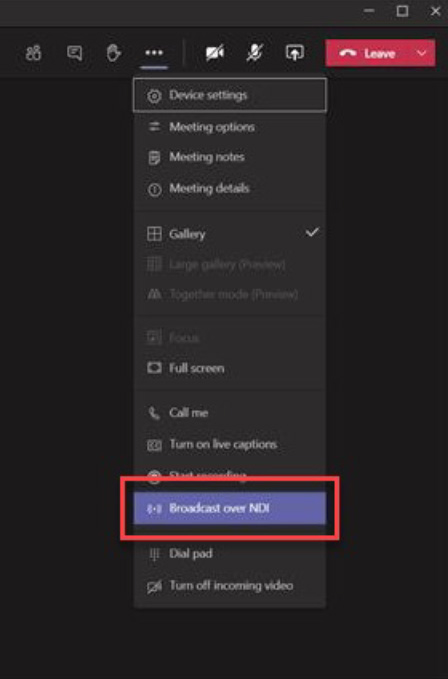

Aktivieren Sie Broadcast over NDI in der Teams-Besprechung

NDI-Feeds enthalten gemischtes Audio aller Teilnehmer, mit Ausnahme des Benutzers auf dem Quellcomputer – aktivieren Sie das Kontrollkästchen Isoliertes Audio, um individuelles Audio für jeden NDI-Feed zu aktivieren

Extrahieren von Inhalten aus einer Teams-Besprechung (Quelle)

Verwendung von Hardware

Dies wird häufig zur Integration in herkömmliche Produktionsumgebungen mithilfe von SDI-Verbindungen verwendet.

Remote-Teilnehmer

Teams treffen

Quelle

Dieses System nimmt an der Teams-Besprechung teil und verwendet ein externes Gerät (AJA oder Blackmagic), um Video-Feeds zu extrahieren.

- Sie können einen sauberen Stream pro Ausgabe aus der Teams-Besprechung extrahieren.

- Geräte mit mehreren Ausgängen können pro Ausgang einen eindeutigen Clean Stream empfangen.

- Nur einzelne (ISO) Video-Feeds (große Galerie, Gemeinsamer Modus oder Desktop-Freigabe werden nicht unterstützt).

Remote-Teilnehmer

Teams treffen

Quelle

Dieses System nimmt an der Teams-Besprechung teil und verwendet ein externes Gerät (AJA oder Blackmagic), um Video-Feeds zu extrahieren.

- Sie können einen sauberen Stream pro Ausgabe aus der Teams-Besprechung extrahieren

- Geräte mit mehreren Ausgängen können pro Ausgang einen eindeutigen Clean Stream empfangen

- Nur einzelne (ISO) Video-Feeds (große Galerie, Gemeinsamer Modus oder Desktop-Freigabe werden nicht unterstützt)

- NDI muss im Teams-Client aktiviert sein (Einstellungen -> Berechtigungen -> NDI-Schieberegler aktivieren).

- Klicken Sie auf dem Quellcomputer mit der rechten Maustaste auf den Video-Feed und wählen Sie Video an Hardware senden.

- Suchen Sie im nächsten Flyout-Bildschirm das Gerät/die Schnittstelle, die Sie verwenden möchten.

- Klicken Sie auf Auflösung, wählen Sie im Flyout-Fenster die gewünschte Auflösung aus und klicken Sie dann Anfang.

Broadcast-Entwicklungskit

Broadcast-Entwicklungskit ist eine Softwarelösung, die es Organisationen ermöglicht, eine Teams-Besprechung in ihrem Mandanten als Quelle (und Ziel) zu verwenden, um Medienströme aus der Besprechung (z. B. Teilnehmer, Bildschirmfreigabe usw.) zu extrahieren und einzuspeisen und sie als Quellen für die Live-Produktion zu verwenden Inhalt.

Das Broadcast-Entwicklungskit Bietet Funktionen zum Extrahieren und Einfügen von Medien aus einer Teams-Besprechung mithilfe des SRT- oder RTMP-Protokolls. Wir empfehlen, nach Möglichkeit die SRT-Protokolle zu verwenden und RTMP (und RTMPS) zu verwenden, wenn das System, das den Feed empfängt/sendet, SRT nicht unterstützt.

Die Lösung funktioniert, indem sie dem Meeting, in dem Sie diese Lösung verwenden möchten, einen Medien-Bot hinzufügt und diesen Medien-Bot verwendet, um die Streams des Meetings zu erfassen und neue Streams einzuspeisen.

Produzieren mit OBS Studio

OBS-Einstellungen für Live-Events

- Starten Sie OBS und gehen Sie zu Datei -> Einstellungen.

- Klicken Ausgang, dann wähle Fortschrittlich Wählen Sie den Ausgabemodus und konfigurieren Sie die folgenden Einstellungen unter Streaming Tab:

- Ausgabe neu skalieren: Aktivieren Sie das Kontrollkästchen und wählen Sie 1280×720

- Encoder: Wenn Ihr PC Hardware-Kodierung unterstützt, wählen Sie diejenige aus, die nicht x264 ist (z. B. QuickSync H.264, NVENC usw.). Wenn Hardware-Kodierung keine Option ist, belassen Sie es bei x264.

- Ratenkontrolle: Stellen Sie sicher, dass CBR ausgewählt ist.

- Bitrate: Geben Sie einen Wert in Kbit/s ein. Normalerweise werden 2000 bis 4000 verwendet.

- Keyframe-Intervall: 2.

- Immer noch am Ausgang Klicken Sie auf die Registerkarte Audio Registerkarte -> Konfigurieren Lied 1 -> Audio Bitrate: 128, 160 oder 192 für die Audiokodierung.

- Klicken Video (auf der linken Seite) und konfigurieren Sie die folgenden Einstellungen:

- Basisauflösung (Leinwand): Dies ist Ihre normale Desktop-Auflösung (normalerweise 1920 x 1080).

- Ausgabeauflösung (skaliert): 1280 x 720 (Encoder-Profile sind für Live-Events auf maximal 720p ausgelegt).

- Allgemeine FPS-Werte: 30 wird normalerweise für Bilder pro Sekunde verwendet.

Die oben genannten Einstellungen verwenden die NVIDA RTX 2080 Ti-Karte. Die Zielauflösung beträgt 1280 x 720 und die Bildrate 30 fps. Sehen Das Weitere Informationen zur NVIDIA-Konfiguration finden Sie im Handbuch.

Produktionssystem – Einbringen von Quellen (OBS NDI-Beispiel)

Isoliertes Video

NDI

Streaming-App (OBS)

Grafik

Hersteller

Auf diesem System wird die Produktionssoftware (OBS, Wirecast, vMix) ausgeführt, um die gewünschten Layouts zu erstellen. Von dieser Maschine/Anwendung aus können Sie den Feed an Ihr externes Publikum senden.

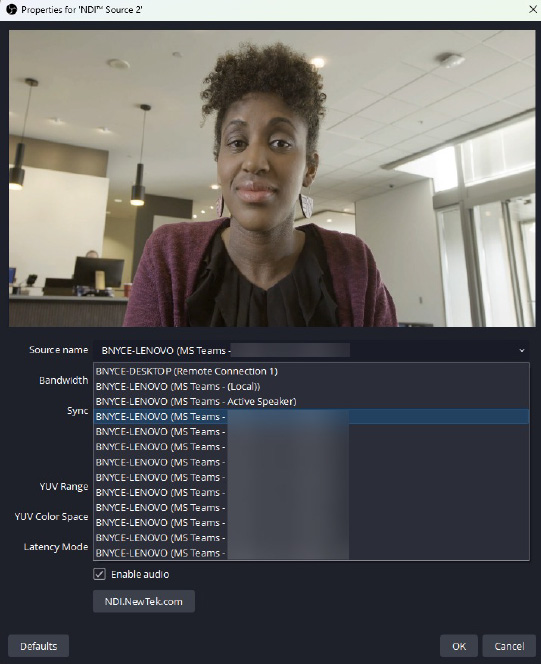

Installieren OBS und das OBS NDI-Plugin (erfordert Neustart).

Erstellen Sie in OBS eine neue Szene und fügen Sie eine neue NDI-Quelle hinzu.

Wählen Sie den gewünschten Feed aus und positionieren Sie ihn in der Szene.

Videovorschau/Assurance Slate.

Liste der verfügbaren NDI-Feeds im lokalen Netzwerk. Der Feed zeigt den Namen des Quellcomputers, die Anwendung und den Deskriptor an.

Audio-Überlegungen

Erdschleifenisolatoren: Wird verwendet, um das Brummen einer Erdschleife zu eliminieren, das auftritt, wenn mehrere Tongeräte miteinander verbunden sind.

Qualität Mikrofone und Audio-Interfaces.

Physische Audiomischer: Wird verwendet, um mehrere Audioquellen wie Mikrofone, über USB angeschlossene Geräte, AUX-Verbindungen und Bluetooth zusammenzuführen.

Virtuelle Audiomischer: leistungsstarkes Audio-Routing über physische und virtuelle Schnittstellen.

Audio-Routing – VoiceMeeter

VoiceMeeter ist ein Beispiel für ein virtuelles Mischpult.

Ausführung

- VoiceMeeter (3 Audioeingänge/-ausgänge)

- VoiceMeeter Banana (5 Audioeingänge/-ausgänge)

- VoiceMeeter Potato (8 Audioeingänge/-ausgänge)

Für die Schritte in diesem Abschnitt wird VoiceMeeter Potato verwendet. Die Konzepte gelten jedoch gleichermaßen für VoiceMeeter und VoiceMeeter Banana.

1

Physische Eingaben

An den PC angeschlossene Geräte (Mikrofon)

2

Virtuelle Eingänge

Bieten Sie eine Möglichkeit, Audio aus verschiedenen Anwendungen in verschiedene Eingänge aufzuteilen

3

Physische Ausgänge

Bietet eine Methode zum Weiterleiten von Audiokanälen an verschiedene physische Ausgänge (Lautsprecher, Headsets).

4

Virtuelle Ausgänge

Stellen Sie eine Methode bereit, um Audiokanäle an verschiedene virtuelle Ausgänge weiterzuleiten

VoiceMeeter – Physische E/A

Der erste Schritt bei der Konfiguration von VoiceMeeter ist die Einrichtung Ihrer physischen Geräte. Dazu gehören Geräte, die sowohl zur Ausgabe (Lautsprecher, Kopfhörer, Audiomischer) als auch zur Eingabe (z. B. Mikrofon, Audiomischer, Audio-Interface usw.) physisch mit Ihrem Computer verbunden sind.

- Wählen Sie das Haupt-Audioausgabegerät aus – allgemeine Empfehlung ist, mit dem A1-Bus zu beginnen.

- Klicken Sie auf A1, um die Geräteliste aufzurufen und Ihren Haupt-Audioausgang auszuwählen.

- Die bevorzugte Reihenfolge ist die Auswahl des ASIO-Geräts (falls vorhanden), dann WDM/KS und dann MME.

- Sie können bis zu 5 Hardware-Eingänge in VoiceMeeter Potato konfigurieren.

- Klicke auf Wählen Sie Eingabegerät um das Menü aufzurufen und das gewünschte Gerät auszuwählen.

- Vorzugsweise wird ein WDM/KS-Gerät ausgewählt (bietet im Vergleich zu MME die beste Latenz).

VoiceMeeter – Virtueller I/O

Voicemeeter bietet auch virtuelle Ein- und Ausgabegeräte. Diese können verwendet werden, um Audio von Anwendungen auf Ihrem PC in verschiedene Kanäle zu trennen und sie zur Verwendung in anderen Anwendungen wie Teams an dedizierte Kanäle weiterzuleiten.

- Potato bietet drei virtuelle Eingaben:

- VoiceMeeter VAIO

- VoiceMeeter AUX

- VoiceMeeter VAIO 3

- Mit den Einstellungen des Windows-Lautstärkemixers können Sie einzelne Anwendungen so weiterleiten, dass sie bestimmte virtuelle Eingänge verwenden.

- Potato bietet drei virtuelle Ausgänge:

- VoiceMeeter VAIO (Bus B1)

- VoiceMeeter AUX (Bus B2)

- VoiceMeeter VAIO 3 (Bus B3)

- Audio kann Bus B zugewiesen werden, um es als Eingang an eine bestimmte Anwendung weiterzuleiten (z. B. ein Mikrofon in Teams).

VoiceMeeter – Audio an Teams weiterleiten

Sie können die virtuellen Ausgänge (unten rechts) mithilfe von Bus B in Teams zuordnen. In diesem Beispiel wird B1 in den Mikrofoneinstellungen für den Teams-Client als „VoiceMeeter-Ausgang (VB-Audio VoiceMeeter VAIO)“ angezeigt.

Live-Dolmetschen in Gebärdensprache

Integration von Live-Gebärdensprachdolmetschen in Live-Events und Meetings von Teams

- Das Dolmetschen in Gebärdensprache auf dem Bildschirm ist eine natürliche und visuelle Form der Kommunikation, die Veranstaltern dabei hilft, gehörlose und schwerhörige Gemeinschaften in ihrer Muttersprache einzubeziehen.

- Bei der Planung einer Veranstaltung mit Live-Gebärdensprachdolmetschung sollten viele technische und produktionstechnische Faktoren berücksichtigt werden.

- Im Folgenden werden Empfehlungen und Best Practices für die Produktion von Live-Events unter Einbeziehung von Gebärdensprachdolmetschern aufgeführt.

Bereiten Sie Ihr Dolmetscherteam vor

Das Dolmetschen in Gebärdensprache ist eine komplexe, mentale Aufgabe, die durch die Bereitstellung zusätzlicher Kontexte und eine vorherige Vorbereitung erheblich erleichtert wird.

Stellen Sie Ihrem Dolmetscherteam Vorbereitungsmaterialien zur Verfügung mindestens eine Woche vor der Veranstaltung. Geben Sie so viele Details wie möglich an, einschließlich Run of Show, Teilnehmernamen, Veranstaltungsvisualisierungen wie PowerPoint-Decks, vorab aufgezeichnete Videos und Transkripte.

Lade mich einDolmetscher bis hin zu Eventproben und Vorproduktionsbesprechungen zur Beantwortung von Fragen zum Inhalt oder zum Veranstaltungsablauf.

Üben Sie alle technischen Elemente in einer Vorproduktionssitzung mit dem Dolmetscherteam. Stellen Sie technische Anweisungen zur Durchführung Ihrer spezifischen Veranstaltung bereit, für den Fall, dass Dolmetscher nicht an den Vorproduktionssitzungen teilnehmen können oder es in letzter Minute zu Personaländerungen kommt.

Technische Produktion

*Viele andere Broadcast-Lösungen wie vMix und Wirecast können NDI nutzen. Dieses Handbuch behandelt nur OBS Studio.

Empfehlungen für Dolmetscherstudios

Internet

Für jede Veranstaltung wird eine starke, stabile Internetverbindung empfohlen; Eine festverdrahtete Verbindung ist am stabilsten.

Beleuchtung

Eine sanfte, gleichmäßige Beleuchtung ermöglicht eine optimale Darstellung der Interpretation und Mimik.

Hintergrund

Ein einfarbiger Hintergrund ist am besten; Einige Zuschauer haben berichtet, dass sie Chroma-Blau oder -Grün bevorzugen.

Kleiderschrank

Schlichte, einfarbige Kleidung, die einen Kontrast zur Hautfarbe bildet.

Platzierung der Kamera

Mittlere Frontalaufnahme auf Augenhöhe.

Produktionsempfehlungen

Platzieren Sie den Dolmetscher in einem gerahmten rechteckigen Kasten mit etwa ¼ der Bildschirmbreite.

Rahmen Sie den Dolmetscher so ein, dass Platz für typische Gebärdenbewegungen bleibt.

Der untere rechte Teil des Bildschirms ist bei den Zuschauern der beliebteste Ort.

Ein Virtual Green Room ist ein zusätzliches Team-Meeting, das die Kommunikation zwischen den Teams vor und während einer Veranstaltung ermöglicht. Diese Besprechung ist getrennt von der Besprechung der Moderator-Broadcast-Teams.

Dolmetscher können nicht an zwei Besprechungen gleichzeitig teilnehmen, daher müssen sie die Besprechung der Virtual Green Room Teams verlassen, um zu einem vereinbarten Zeitpunkt vor Beginn ihrer Dolmetschsitzung an der Besprechung der Presenter Broadcast Teams teilzunehmen.

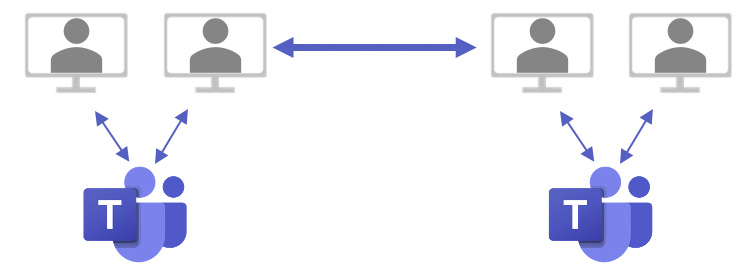

Virtueller grüner Raum des Dolmetschers

Virtueller grüner Raum

Teambesprechung 1

Moderator und Dolmetscher

Teambesprechung 2

Empfehlungen zum Dolmetscherwechsel

Dolmetscher arbeiten in der Regel in einem Team aus zwei oder mehr Personen und wechseln sich während einer Veranstaltung alle 15 bis 20 Minuten ab. Bei Veranstaltungen über zwei Stunden kann ein größeres Dolmetscherteam erforderlich sein.

Der Wechsel zwischen Dolmetschern in der Mitte der Veranstaltung sollte gut geplant und geprobt sein.

Vereinbaren Sie vorab ein Schaltsignal zwischen Dolmetschern und Produktion.

Nach dem Signal sollte die Produktion mit dem Umschalten warten, bis der Dolmetscher seine Hände vom Rahmen nimmt.

Integrieren Sie nach Möglichkeit die Dolmetschervermittlung in den Run of Show. Bereiten Sie sich bei Bedarf auf ungeplante Pausenanfragen des Dolmetschers vor.

Abwechselnd alle 15–20 Minuten.

Verwendung von OBS + NDI zur Integration der Gebärdensprache in Teams

Fügen Sie Ihrer OBS-Szene über dem Hintergrund eine Interpreter-NDI-Quelle hinzu.

- Passen Sie es auf ca. ¼ der Bildschirmbreite an.

- Bleiben Sie verhältnismäßig.

- In der unteren rechten Ecke platzieren.

Wenden Sie einen Begrenzungsrahmen auf alle NDI-Quellen an, um eine automatische Skalierung zu verhindern:

- Von dem Quellen Bereich, klicken Sie mit der rechten Maustaste NDI-Quelle.

- Bewegen Sie den Mauszeiger darüber Verwandeln, klicken Bearbeiten Sie die Transformation.

- Aus Begrenzungsrahmentyp wählen Auf äußere Grenzen skalieren.

Erstellen Sie einen Rahmen:

- Von dem Quellen Klicken Sie im Bereich auf die Schaltfläche „+“.

- Auswählen Farbquelle.

- Auswählen Erstelle neu, geben Sie einen Namen ein, klicken Sie OK.

- Klicken Wähle Farbe.

- Gewünschte Rahmenfarbe auswählen, klicken OK.

Klicken und ziehen Sie, um die Größe der Farbquelle anzupassen und den Rahmen über der NDI-Quelle im Quellbereich zu platzieren.

Programmausgabe an Interpreter

Die Bereitstellung der Programmausgabe an den Dolmetscher ist von entscheidender Bedeutung, um das Verständnis des Moderators/Sprechers zu erleichtern und zusätzliche visuelle Elemente bereitzustellen, die der Dolmetscher dem Publikum vermitteln muss.

Verwenden Sie entweder „Bildschirm teilen“, um die Inhalte an die Präsentationsteam-Besprechung weiterzugeben, oder verwenden Sie die virtuelle OBS-Kamera/NewTek-Virtual-Kamera, um das Programm-Feedback an die Dolmetscher-Besprechung weiterzuleiten.

Der Dolmetscher gibt dem Zuschauer das „Blick“-Zeichen, um ihn darauf aufmerksam zu machen, dass er sich die Bilder auf dem Bildschirm ansehen soll.

Audio-Routing in OBS

Zusätzliches vorab aufgezeichnetes Material, das übersetzt werden muss, muss an den Dolmetscher weitergeleitet werden. Stellen Sie die Audioausgabe des OBS-Programms nicht so ein, dass sie zur Präsentationsteambesprechung zurückkehrt, da dies zu einer Rückkopplungsschleife führt. Um nur den zuvor aufgezeichneten Inhalt zurückzugeben, ist ein erweitertes Audio-Routing erforderlich.

Produzenten können Audio für vorab aufgenommene Elemente manuell ein- und ausschalten, um Rückkopplungen zu vermeiden, oder Software- oder Hardware-Audio-Routing verwenden.

Unsere Empfehlung ist die Verwendung des OBS-Plug-ins „Audio Monitor“: Dies ermöglicht die Weiterleitung ausgewählter Quellen an einen zusätzlichen Ausgang.

Dolmetschervermittlung in OBS

Ideal ist es, Dolmetscherwechsel für bestimmte Pausen im Voraus zu planen. Bei einer Live-Veranstaltung kann es aus verschiedenen Gründen erforderlich sein, geplante Umstellungen zu ändern. Verwenden Sie doppelte Szenensätze, um an jedem Punkt des Programms nahtlos auf neue Interpreter umzusteigen.

Erstellen doppelter Szenensätze

- Klicken Sie mit der rechten Maustaste auf eine Szene im Szenen Feld

- Auswählen Duplikat

- Geben Sie den gewünschten Szenennamen ein und klicken Sie OK. Wiederholen Sie dies für alle Szenen.

Ordnen Sie die verschiedenen Dolmetscher entsprechend zu NDI-Quelle für jedes Szenenset.

Verwenden Sie OBS Studiomodus um eine Vorschau des nächsten Interpreters vor einem nahtlosen Übergang anzuzeigen.

Weiter zu Phase 3: Nach dem Event

Fahren Sie mit der letzten Phase unserer Anleitung für virtuelle Veranstaltungen zur Verwaltung, Produktion und Durchführung Ihrer individuellen Produktionsveranstaltung fort.

Spielbuch fortsetzen